Lauwarme Cervisia Revisited

oh, gestern vor 5 jahren hat die infantilisierung/verlauwarmung von twitter begonnen: https://hackr.de/2009/07/29/lauwarme-cervisia #ornithology

— Markus Spath (@hackr) July 30, 2014kleiner nachtrag zu lauwarme cervisia das vor ziemlich genau 5 jahren den anfang vom (natürlich endlosen) ende von twitter markierte. seit diesem zeitpunkt versuchen sie, twitter zu managen. einerseits bezüglich den imperativen wachstum und monetarisierbarkeit; andererseits als versuch den usern nahezulegen, was twitter resp. ein tweet zu sein hat.

ich wärme das auf, weil die resilienz von twitter, also wie gut es nach fünf jahren interventionen der teilweise schon blöderen sorte immer noch funktioniert, doch erstaunlich ist (wobei das natürlich eben keine leistung von twitter ist, sondern eine eigenschaft des datentyps tweet. das antifragile potential haben sie natürlich zerstört.)

(die aktuelle kampfmetrik ist deklarierterweise die anzahl aktiver eingeloggter user und das ausgemachte mittel scheint konversation um jeden preis zu sein. die startseite ist für alle nichteingeloggten zb überhaupt nur noch ein formular zur anmeldung, sogar das suchfeld wurde eliminiert:

^ twitter 2014.

^ 2009 gab es zumindest noch ein suchformular und eine liste mit den trendenden hashtags.

die falsche strategie von ihnen ist, nichts ahnende leute zu fleissigen twitterern machen wollen, nachdem man sie erst mal zur anmeldung genervt hat. bis sie den bereich zum abstellen der benachrichtigungsmails gefunden haben, haben wir sie schon im sack und mit den monatlichen ‘we missed you’ emails bekommen wir zumindest einen klick für unsere metrik für unsere investoren. miniquiz: was wäre die richtige(re) strategie?

die falsche grundannahme von ihnen ist, dass twitter eine plattform für überhaupt alle ist – und das geht zurück bis zu ev williams und ihren anfängen. im falle twitter stimmt das zwar tatsächlich, aber nur als ‘ideal’, und das ist ein fundamentaler unterschied. real gibt es nämlich zu jedem zeitpunkt nur eine potentialität (die sich im laufe der zeit natürlich verschiebt). statt also zu versuchen, die jeweils konkreten potentialitäten zu entfalten und das gesamtmilieu für die potentialität zu verbessern, versuchen sie zu rekrutieren und zu missionieren und zerstören gerade damit die latenten potentialitäten.)

Ich weiß, wo du letzten Sommer geschlafen hast

I Know Where Your Cat Lives – eine art plattform für postprivacy cats.

Pinboard Is Five Years Old

^ Pinboard wird fünf

My job is to project an aura of calm, solvency, and permanence in an industry where none of those adjectives applies. People are justifiably risk-averse when it comes to their bookmarks, and they are looking for stability.

(siehe Pinboard Is Four Years Old, Pinboard Turns Three, Two Years of Pinboard und One Year Of Pinboard)

omg, Popular Plus

^ next up in der selfreaggregate reihe: Popular Plus (meine plusse mit 5+ plussen; man muss ein paar sekunden warten, bis das google richtig anzeigt)

siehe auch:

- Plusses 1-100

- Plusses 101-200

- Plusses 201-300

- Plusses 301-400

- Plusses 401-500

- Plusses 501-600

- Plusses 601-700

9 Jahre live.hackr

![]()

![]()

![]()

![]()

![]()

![]()

![]()

![]()

![]()

live.hackr feiert heute seinen 9ten Geburtstag!

Einen herzlichen Dank an alle, die hier immer noch vorbeischauen, ohne euch wäre es nicht wirklich lustig!

Annie Edison

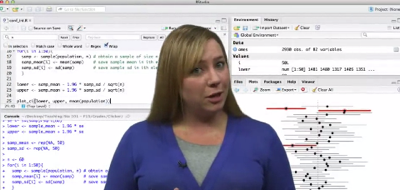

Nur ein kleines Update zu Tough Graders und Data Moocs Spring/Summer 2014 und Data Moocs Spring 2014 : ich hab mich jetzt auch noch durch die 9 Kurse der Data Science Specialization von Johns Hopkins auf Coursera (ich muss leider sagen) durchgewerkelt.

- The Data Scientist’s Toolbox

- R Programming

- Getting and Cleaning Data

- Exploratory Data Analysis

- Reproducible Research

- Statistical Inference

- Regression Models

- Practical Machine Learning

- Developing Data Products

Unterm Strich sind die 9 Kurse zwar eine Zumutung auf jeder Ebene (bipolare schwierigkeit der kurse, überwiegend eine lieblose neuverteilung von material das bei ihnen halt herumlag, nonpräsenz der professoren in den foren und nonreaktivität auf auch massive technische probleme, ungetestete quizzes, zusammenhanglose und aus dem leftfield kommende projekte, uvm.) aber es verstecken sich schon auch das eine oder andere Nugget; gute Statistiker und R-Zauberer sind die Johns Hopkins Biostats Guys sicherlich (ich erspare euch und mir hier ein genaueres was und warum, aber falls ihr die kurse in erwägung zieht fragt mich jederzeit)

Ein Grundskill ist für Selbstlernen sicherlich, einerseits die Qualität des moocs adäquat einzuschätzen und andererseits auch bei suboptimalen moocs das Beste für sich draus zu machen – und dafür ist die Spezialisation wohl das Boot Camp.

Orkut Badges

^ google killt jetzt auch noch orkut – ich will hiermit nur meine badges retten.

—

orkut badges:

kosmar

http://www.orkut.com/Main#Profile?uid=2986529123676920731

konterfai

http://www.orkut.com/Main#Profile?uid=11348050944916154663

chl

http://www.orkut.com/Main#Profile?uid=6108653050712448426

lotman

http://www.orkut.com/Main#Profile?uid=7631298122942634788

rany keddo

http://www.orkut.com/Main#Profile?uid=17346300698472834362

mauszfabrick

http://www.orkut.com/Main#Profile?uid=11686907458612718389

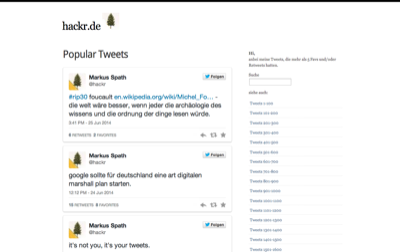

omg, Popular Tweets

^ next up in der selfreaggregate reihe: Popular Tweets (meine tweets mit 5+ favs und/oder retweets)

siehe auch:

Google Cardboard

^ der Hit der I/O: Cardboard

I/O 2014 (Android Edition)

in alter Tradition zumindest eine kleine Übersicht der Google I/0:

- Coming to a screen near you – der Überblick von Google

- Google I/O: Design, Develop, Distribute – noch ein etwas technischerer Überblick von Google

- This is material design – eine Art Vorstellung von Material Design, dem neuen Design vom kommenden Android L

- Cloud Platform at Google I/O – new Big Data, Mobile and Monitoring products – es gibt ein bissl Monitoring und einen Cloud Dataflow

- Cast Away with Android TV and Google Cast – neben Chromecast gibts jetzt auch ein Android TV

von Projekten wie Google+ oder Google Glass hat man nicht viel gehört, ingesamt sind sie wieder bei der neuen Bescheidenheit von 2012 gelandet.

Die Talfahrt

kurze (oder besser nicht ganz so kurze) unterbrechung der unterbrechung, aber ich miste gerade mein scrivener aus und wollte diesen text nicht wegschmeissen, würde ihn mit der wm vor der tür in absehbarer zeit aber wohl auch nicht abrunden, also poste ich ihn ein bisschen aktualisiert hier, die beispiele sind sicherlich nicht besonders gut gewichtet. ungewollt ist es jedenfalls eine art nachtrag zu 5 jahre live.hackr, das vor 4 jahren und irgendwie am höhepunkt der konzeptionellen ausdifferenzierung und vielfalt im web geschrieben wurde, sich der scheitelpunkt der entwicklung aber gerade abzuzeichnen begann.

unter talfahrt verstehe ich etwa die symptome und effekte, die dadurch entstanden, dass die gesellschaftlichen subsysteme nach der ersten schockstarre endlich ihre abwehrmechanismen gegen das web voll in gang gebracht haben (oft in form von rechten wie urheberrechten, patentrechten, datenschutzrechten, leistungsschutzrechten, pixelschutzrechten, rechten aufs vergessenwerden, usw.), oder die dadurch entstanden, dass die gleichen oder andere gesellschaftlichen subsysteme begonnen bzw. verstärkt haben, von den techniken selbst maßlos gebrauch zu machen (z.b. überwachung, vollständige privatisierung des immateriellen, beschleunigung der ungleichheiten durch netzwerkeffekte, usw.), oder die dadurch entstanden, dass startups zu konzernen und konglomeraten wurden und damit andere prioritäten ausbildeten (z.b. die verdummung von google oder twitter), oder aber auch das ganz natürliche gemetzel unter den diensten und das aussterben/verlernen/vergessen von technokulturellen techniken bei reterritorialisierung auf wenigeren und immer geschlosseneren plattformen.

in dieser implosion wurden allerdings einige verhältnisse und prinzipien deutlich, die zwar retrospekiv nicht überraschen, die aber in der phase der expansion eben nicht bedeutsam waren – und zwei bereiche davon möchte ich hier zumindest anreissen. und nur zur sicherheit: ich versuche hier nur das nicht-funktionieren, die störungen und filter der ersten welle zurück zu erklären, nicht eine bestandsaufnahme vom aktuell funktionierende zu geben. ich spare euch also das bauchpinseln, wachstumscharts oder einen internetoptimismus, das halte ich für gegeben. es kommt also, das sag ich euch gleich, eher ein downer.

der abbau von dingen und techniken

leicht dramatisiert sind wir in den letzten jahren von einem wilden garten mit erstaunlicher artenvielfalt und wildwüchsiger schönheit zu betreutem wohnen und überwachtem cluburlaub übergegangen. natürlich gibt es enklaven, gallische dörfer und biotope, aber was die gesellschaftlich paradigmatische praxis betrifft. den rückgang der artenvielfalt kann man in drei gruppen unterteilen, wobei jede gruppe unterschiedliche gründe und auswirkungen hat:

1. dinge, die einfach überholt wurden

viele dinge, techniken und gerätschaften wurden einfach von anderen dingen, techniken und gerätschaften überholt, weil sie kleiner, schneller, billiger, nützlicher oder besser waren. (man denke an den trolly mit dem pc, den bruce sterling auf der sxsw herumschiebt. niemand würde sich bücken und ihn aufheben, selbst wenn man dafür geld bekäme.)

über diese gruppe gibt’s glaub ich wenig diskussionsbedarf, auch wenn die effekte davon enorm sein können und ganze technologien fast verschwinden lassen, nur um aber einer viel stärkeren und schnelleren welle der nächsten generation an technologien platz zu machen. (nur als beispiel: 1,7 mrd. smartphones mit mobilem internetzugang ändern natürlich nicht nur die gesamte globale infosphäre und alle damit assoziierten ströme fundamental, sondern erzeugen ein genuin neues ‘infoökonomisches dispositiv’. und darüber wird sich niemand wirklich wundern, ausser vl. journalisten, blogger und analysten). vieles davon lässt sich jedenfalls gut mit halbjährigen trendreports dokumentieren.

2. dinge, die nützlicher klangen, als sie waren

in ihrer funktionslogik (nicht in ihrer wirkung) etwas interessanter sind vl. die dinge, techniken und gerätschaften, die zunächst ausgesprochen nützlich klangen, sich in der folge aber als weniger nützlich oder wichtig als vermutet herausgestellt haben. grundsätzlich wird natürlich immer alles machbare auch gemacht. und durch das web wurde so viel machbar, dass wir in der ersten phase auch wirklich vieles ausprobiert haben – und fast alles klang zumindest für die macher wie eine gute idee. aber nicht alle, genauer gesagt nur die allerwenigsten dinge und techniken haben sich dann als tatsächlich wertvoll herausgestellt, und viele techniken, die besser klangen als sie waren, wurden in der folge wieder eingestellt bzw. haben sich auf niedrigem aktivitätslevel neu eingependelt.

beispiele:

- social bookmarking (sorry)

- tagging (sorry)

- blogging (sorry)

- abonnieren und lesen von feeds (sorry)

- startseiten wie netvibes (sorry)

- lifestream- und andere aggregatoren (sorry)

- local check-ins (sorry)

- bürgerjournalismus (sorry not sorry; aber niemand setzt sich hin und verfasst zum spass journalistische beiträge, wenn es ein halbwegs gut funktionierendes mediensystem gibt. was aber zumindest eine zeit lang funktioniert sind halt medienkritische geschichten.)

- usw.

das grundproblem ist immer das gleiche: als technik entfalten sie zu wenig strukturelle koppelungen, um eine gewisse nachhaltigkeit zu etablieren. im ersten schwung können die kosten durch übermotivation der neuartigkeit bereitgestellt werden, aber mittelfristig wird dann vieles eben finanziell nicht tragbar. auch bei der adaption eines dienstes durch benutzer gibt am anfang eine dynamik der neuheit, die dann verfliegt. der ‘naive’ glaube daran, dass dinge mit neuer technik automagisch besser werden, ist zwar auf gewisse weise nützlich, weil er das experimentieren erst ermöglicht, aber er hilft den je konkreten techniken oder technologien halt mittelfristig auch nix.

und neben diesen ‘schlechten guten ideen’ gab es natürlich auch den abbau vieler ‘schlechter schlechter ideen’, also von ansätzen, bei denen man das ende schon am anfang absehen konnte.

diese liste wäre sehr lang, aber eine sich zombieartig regenerierende fixe idee von ingenieuren ist jedenfalls zu versuchen, die perfekte algorithmische empfehlungsmaschine zu bauen, die dem menschen in jeder situation zu jedem zeitpunkt an jedem ort das perfekte produkt empfiehlt und ganz allgemein immer schon vor dem menschen selbst weiß, was er will. die ergebnisse stehen fast immer mehr im weg als sie nützen, aber mehr noch: sie wollen das falsche problem lösen, ein bisschen mehr dazu hier. die übernahme von beats durch apple zeigt, dass zumindest apple das wirkliche problem erkannt hat. (in einem satz: apple hat verstanden, dass musik kein problem für empfehlungsalgorithmen, sondern eine funktion von geschmack, vertrauen und begehren ist – und das war ihnen 3 mrd. dollar wert, weil sie es in 13 jahren itunes und ipod nicht selbst lösen konnten. nicht dass sie es nicht versucht hätten, man denke nur an ping, genius, itunes radio, usw.) auch fast alles, was primär auf aufwendigen content oder beteiligung der user setzt, braucht ein kleines sinnwunder oder extrem gutes design des sozialen objekts und der ströme.

andererseits: was wirklich nützlich wird und was ein dud bleibt muss sich einfach zeigen, das experimentieren hat also schon auch mit den anscheinend schlechtesten ideen seine berechtigung. die wenigsten fälle an wert entstehen aber durch features oder technik. game of thrones wurde und wird auf dos geschrieben.

3. dinge und techniken, die von höheren zu niedrigeren aggregatszuständen übergegangen sind

das ist die wohl interessanteste kategorie und sie klingt grundsätzlich ähnlich wie die dinge, die einfach nicht so nützlich wie vermutet waren, aber ich möchte sie deshalb unterscheiden, weil die dahintersteckende funktionslogik eine andere ist. dinge und techniken, die von höheren zu niedrigeren aggregatszuständen übergegangen sind, sind nämlich eben potentiell nützlich, nur konnten sie nicht genügend ‘kraft’ aufbringen, um sich gegen die kleineren/schnelleren/leichteren alternativen zu behaupten, von denen es dann sehr viel schneller sehr viel mehr gibt, weil sie eben kleiner, schneller und leichter sind.

neben den ‘guten schlechten ideen’ gibt es also auch eine art entropie, bei der ‘hochwertigere’ techniken durch ‘niederwertigere’ ersetzt werden. grundprinzip ist, dass sich die alternativen zunächst vom ursprünglichen ding deterritorialisieren, sich dann aber auf einer neuen ebene als neue formation reterritorialisieren. im unterschied zu den ‘guten schlechten ideen’ besteht bei diesen ‘schwachen guten ideen’ aber immer die möglichkeit, sie zu revitalisieren, oder besser: kann es mitunter sinnvoll sein, zu versuchen sie zu revitalisieren, wenn man diesmal dann aber auf die voraussetzungen und rahmenbedingungen zu achtet (miniquiz am rande: was dürfte was aussichtsreichste schraube sein, die man bei einem ‘neustart’ einer ‘schwachen guten idee’ festgezogen haben sollte?).

beispiele:

- von blogs zu tumblr, g-plus oder quora.

- vom journalismus zu huffington post, buzzfeed oder heftig.

- von flickr zu instagram und selfie.

- von subscribern zu followern.

- von tags zu hashtags.

- vom meme zum viral. während es heute zwar noch immer gelegentlich als ‘meme’ bezeichnete phänomene gibt, die goldene zeit der meme ist vorbei. das paradigmatische modell für sozialen erfolg ist nun das viral, das sich tautologisch selbst beweist.

- von rocketboom und lifecastern zu beauty gurus und gamecastern. (man denke nur an justin.tv, das alle bisherigen aufzeichnungen bald löschen wird, dessen spin-off für games twitch aber gerade von google bei einer kolportierten bewertung von 1 mrd. umworben wird.)

- vom postmodernen pastiche auf myspace zur fanpage auf facebook.

- von der gleichzeitigkeit von ungleichzeitigkeiten zu einer allgemeinen unzeitlichkeit.

- von lolcats zu caturday und grumpy cat.

- usw.

konfliktierende interessen

während die verschiedenen gruppen des abbaus der arten gwm. ein symptom der aktuellen talfahrt sind, sind verschiedene gruppen ‘konfliktierender interessen’ zwar meistens nicht die ursache, aber gwm. die rahmenbedingung für die ausdifferenzierungsmechanismen, die uns dann oft vor spieltheoretische konstellationen wie dem usergefangenendilemma stellen.

vorab: das sind grundsätzlich alles duh’s. und während das natürlich auch keine eigenheit des webs ist, so sehen wir doch erst in den letzten jahren, wie sich latent immer schon vorhandene unterschiedliche interessen als ganz konkreten effekte im web realisieren, indem sie sich in den ‘neuen’ gegebenheiten neu konstituieren bzw. teilweise auch erst mit dem web realisierbar und damit als konflikt sichtbar wurden.

1. die interessen der firmen stimmen nicht mit denen der benutzer überein

am anfang jeden startups müssen die interessen des startups und die interessen der benutzer natürlich synchronisiert sein. zumindest muss es für die benutzer eine art nutzenüberschuss und werterzeugung geben, sonst würde es ganz einfach nicht benutzt und es gäbe kein startup; aber ab einem punkt im lebenszyklus der firma beginnen die interessen oft zu divergieren und spätestens mit dem ipo werden die benutzer meistens nur noch als parameter zur optimierung von verschiedenen kennzahlen konzipiert. was nicht notwendigerweise sofort auch für die benutzer schlecht sein muss, es gibt sicherlich hinreichend gut funktionierende symbiotische modelle. aber öfter als nicht geraten die effekte zum nachteil der benutzer, der communities oder der ‘gesellschaft’.

ich hoffe es ist klar, dass das was anderes impliziert, als das konzipieren von google, amazon, apple, facebook und co als geldgierige, imperialistische und grundsätzlich abzulehnende konzerne, die deshalb auch mit den blödesten mitteln bekämpft werden können und vor denen die gesellschaft und vor allem die verlage beschützt werden müssen. das problem hier ist nicht, dass sie versuchen von ihren benutzern zu profitieren, das problem ist, dass sie selbst verlernen, wert zu erzeugen. (ein grund dafür könnte übrigens sein, dass die ab einer gewissen organisatorischen grösse eingeführten ‘manager’ selbst nur gelernt haben, in neoliberalen/globalisierten mustern zu ‘führen’ und zu ‘denken’ und nicht verstehen, dass web- und technologiestartups nach tatsächlich anderen ökonomischen logiken funktionieren könnten und sollten.) und nur zur sicherheit: das bedeutet natürlich auch nicht, dass man sie nicht für das wirklich kritisierenswerte kritisieren sollte. das problem mit der aktuellen europäischen kritik am komplex us-tech ist, dass das falsche kritisiert und bekämpft wird und dass die effekte die gegenteiligen vom erwünschten sind.

interessanterweise sind es vor allem die tech-blogger, die am allerwenigsten kapieren, dass das, wozu sie die firmen anfeuern, exakt die nachteile für die benutzer erzeugt, deren effekte sie dann bejammern.

unternehmen durchlaufen jedenfalls einen gewissen lebenszyklus und manche unternehmen landen irgendwann in einer lebensphase, in der sie gewissen erwartungen anderer genügen müssen, was viele unternehmen in ganz andere wesen und manchmal in walking dead transformiert. hier muss ich übrigens wirklich facebook loben; aus dem trio google/facebook/twitter sind sie nämlich die einzigen, die sich auch nach ihrem ipo noch immer relativ konsequent am ursprünglichen eigenen sozialen objekt orientieren und klare grenzen ziehen. sowohl google als auch twitter tun sich als von managern optimierte unternehmen mit ihrer eigenen sinn- und wertstiftung viel schwerer, wobei twitter der mit abstand größte dolm ist (d.h. die am leichtesten vermeidbaren kapitalen fehler macht, im grunde müssten sie ja wirklich nur nichts machen) und google der größte unnötige wertvernichter zumindest im web ist und eine lange trophäensammlung kleinerer und größerer böcke angesammelt hat, siehe google studies, nur erzeugen halt beide, vor allem natürlich google, gleichzeitig auch so einen riesigen sozialen und kommunikativen überschuss, dass das auf absehbare zeit ohne echte kosten oder konsequenzen für sie bleiben wird.

ein hauptgrund für diesen interessenskonflikt ist der oben erwähnte übergang von höheren zu niedrigeren aggregatszuständen. wie soll ein unternehmen wie yahoo reagieren, wenn der ‘hochbrauige’ und viele jahre dominierende datentyp flickr mit entwicklungen zu tun bekommt, bei denen die kombination aus handy, mobilem internet und für einen sozialisierten strom optimierte plattformen wie instagram und tumblr oder auch messenger zu einer exponentiellen explosion der zirkulierenden fotos führt, die sie im staub stehen lassen?

im grunde gibt es nur zwei möglichkeiten: sie bleiben entweder dem originalen datentyp treu, auch wenn sie dann marktanteile verlieren (was, nur nebenbei, ja nicht notwendigerweise weniger aktivität oder einnahmen bedeutet). oder sie versuchen sich zu transformieren, was unter umständen gelingen kann, aber in jedem fall den ursprünglichen sinn zerstört. das kann mitunter auch gelingen, wenn man unter gelingen als marke überleben versteht, wenn die eigene schwungmasse gross genug oder wenn für die user die kosten für einen absprung zu gross sind. aber der ursprüngliche datentyp wird natürlich trotzdem zerstört und die wahrscheinlichkeit des nichtgelingens ist hoch, weil ihre organisatorische dna den neuen datentyp oft nicht versteht. und sie öffnen damit natürlich wieder die tür für nachrücker, die dann von unten, von der seite und dann eben auch von oben kommen können (z.b. medium, das sich gwm. über das soziale objekt bemühtheit definiert und sich quasi auf die blogs setzt).

2. die interessen der regierungen stimmen nicht mit denen der bürger überein

das ist ein viel zu großes thema, das ich weder hier noch sonst behandeln kann, aber ich will es nicht unerwähnt lassen, weil man viele probleme damit verstehen kann.

das paradigmatische beispiel ist natürlich überwachung: aus irgendeinem grund lieben regierungen nichts mehr, als ihre bürger und wenn wir schon dabei sind die ganze welt möglichst total und jedenfalls mit allen ihnen zur verfügung stehenden technischen mitteln zu überwachen. ein paar worte dazu etwas weiter unten.

eine variation davon ist eine vermeintliche aber falsche orientierung am bürger. beispiel hier etwa das recht auf vergessen, das als ‘sieg für datenschutz und gegen google’ gefeiert wird, aber die echten probleme nur verschlimmert oder über die hintertür erst konstruiert. siehe das ‘gut gemeint ist schlecht gemacht’ weiter unten.

insgesamt werden regierungen und regierungsorganisationen zunehmend selbst das eigentliche problem, siehe lazy blog ep. 23

3. die interessen der journalisten stimmen nicht mit denen der leser oder der gesellschaft überein

auch das ist ein viel zu großes thema, das ich weder hier noch sonst behandeln will oder kann, aber auch das soll nicht ganz unerwähnt bleiben, weil auch das so einiges erklärt. journalismus ist vor allem in deutschland leider eines der organe geworden, das die gesellschaftlich schädlichsten abwehrstrategien gegen das web ausgebildet hat, was doppelt blöd ist, weil die deutsche seele diskurs tendenziell nur massenmedial sanktioniert akzeptiert.

journalismus ist ingesamt natürlich eine unwahrscheinliche form, die eine zeit lang eine gewisse stabilität gefunden hat, deren bisherige ökonomie aber mit dem internet ganz real zu bröckeln begonnen hat. was sie tun sollten oder könnten ist ein anderes thema, hier aber sei erwähnt, dass was das thema web betrifft von den massenmedien eine absichtliche oder unabsichtliche volksverblödung betrieben wird, die sich natürlich ungünstig auf die entwicklung auswirkt, weil der großteil der bevölkerung einfach falsch informiert wird und deshalb oft auch phänomene nur falsch bewerten kann, was dann wieder als beweis für die richtigkeit der falschen informationen herangezogen wird.

(karma am rande: der journalismus bekommt mit buzzfeed, heftig und co nun endlich die rechnung dafür präsentiert, dass sie die nullerjahre mit dem belächeln und verspotten von zuerst blogs und dann twitter verbracht haben, die mit ihrer zukunft wenig bis nichts zu tun haben bzw. hatten. die irritation und konsternation darüber, dass es da plötzlich was anderes gibt, wo jeder seine meinung publizieren konnte und kann, hat sie blind für alle ihre existenz tatsächlich betreffenden entwicklungen gemacht. mit der aktuellen hysterie – man denke an das schnipsel- und leistungsschutzrecht, den ‘kampf’ gegen google, das am besten zerschlagen werden soll, usw. – wiederholen sie gwm. diesen ersten fehler, nur dieses mal ganz brav nach marx und hegel nicht als tragödie, sondern als farce.)

ursachen und fehler

während die verschiedenen gruppen des abbaus der arten gwm. ein symptom und die verschiedenen gruppen konfliktierender interessen gwm. ein katalysator der aktuellen talfahrt sind, gibt es eine palette an anderen kleineren und grösseren ursachen und fehlern, verstärkern und verhinderern, die die derzeitige situation beeinflussten. hier nur vier signifikante:

1. das fehlen eines ethischen kompasses

das fehlen eines ethischen kompasses ist eine der hauptursachen für einige der angedeuteten missstände.

das web hat auf institutioneller ebene nur ein problem, weil institutionen keinen ethischen kompass haben. daten selbst sind nicht das problem, nur die art, wie sie von unternehmen, organisationen und staaten verwendet werden. wenn sich alle (auch geheimdienste) an dem orientieren würden, was (auch für geheimdienste) gesellschaftlich sinnvoll und nicht an dem, was technisch machbar ist, dann hätten wir kein problem. es geht nicht darum, eine situation herbeizuwünschen, die es nicht geben kann, oder zu verleugnen, dass staaten, organisationen, menschen und sogar katzen mitunter egoistische, territoriale, neidische, irrationale oder gierige impulse haben und denen gelegentlich auch folgen. es geht aber wirklich darum, in der diskussion und bewertung dieser aktivitäten dann zu verstehen, was die ursache und was nur ein mittel oder eine wirkung ist.

das problem an der totalüberwachung der menschheit ist doch nicht, dass mit unserem leben daten anfallen, die geschützt werden müssen, sondern dass eine staatliche institution eines gwm. erleuchteten staates überhaupt auf die idee kommen kann, dass man am besten alle daten aller speichern könnte. und dass das dann auch mit dutzenden milliarden gefördert und realisiert wird, indem das weltweite kommunikationssystem mit einem rhizomatisches geflecht an sensoren infiltriert wird, die wenn möglich bis zum letzten endgerät vordringen und es anzapfen können. aber dass der staat und die staatengemeinschaft keine kontroll- und bewertungsmechanismen ausgebildet haben, die dem von selbst entgegenwirken, einfach weil es ein offensichtlicher wahnsinn und solider grundstein eines präventions- und überwachungsstaats ist, oder weil es am grundvertrauen in kommunikation – und also dem stoff für alles andere – sägt, ist der eigentlich skandal und eine echte schande für die welt und grund für eine eselsmütze für alle beteiligten.

die daten sind zwar das mittel, mit denen das möglich wurde, aber sie sind halt eben auch tatsächlich nur das mittel. das problem ist die nicht mehr vorhandene ethik der organisationen.

nur am rande: die eigene ethik (bzw. die abwesenheit derselben) wird übrigens oft erst sichtbar, wenn es probleme gibt. im fall der massenmedien und des journalismus hat man die ich sag mal löcher und lücken lange nicht gesehen, weil es die längste zeit halt hinreichend gut funktioniert hat. die abwesenheit eines eigenen sinns wurde erst sichtbar, als sie probleme bekamen und nicht mehr weiter machen konnten wie davor. ohne sinn (also etwa: wenn man den leser als nichts anderes als eine page impression wahrnehmen und bewerten kann, die dann hoffentlich auch noch auf einen werbebanner klickt, wenn sie schon da ist) befindet man sich aber schnell in einem race to the bottom um diese dann eben sinnlosen klicks (wobei das race natürlich selbst auch wieder potential für neue formen hat, nur stehen sich die incumbents da immer selbst im weg). blogs andererseits können deshalb extrem ineffizient arbeiten, weil sie ihren eigenen sinnüberschuss selbst erzeugen. es reicht eben schon aus, wenn der blogger für sich selbst ausreichend interessant ist, jeder leser ist da eher ein willkommener gast.

das gilt aber natürlich nicht nur für text, sondern für jedes andere medium auch. wir sehen das wie oben angedeutet auch bei flickr, twitter, google, usw. wer den eigenen sinn verliert, landet dann schnell bei der sinnlosen optimierung, die im idealfall halt ein erträgliches alternatives gleichgewicht auf niedrigerem niveau findet.

2. das fehlen eines schützenden und inkubierenden diskurses

über die theorielosigkeit im web 2.0 hab ich schon vor 4 jahren gejammert, warum da so gar nix kommt ist mir wirklich ein unerklärliches rätsel, so ziemlich jede andere disziplin hat zumindest ein gewisses bündel sozial ausgehandelter begrifflichkeiten generiert, die dann ‘dichtere’ kommunikation erlauben usw., aber das ist natürlich ein moo point. das web selbst hat sich jedenfalls als nicht besonders gut herausgestellt, ‘organische’ intellektuelle hervorzubringen oder die anderer sparten zu integrieren. es gibt zwar einige subdiskurse verschiedener ‘crowds’ (die netzpolitik crowd, die medienkritik crowd, die gründer crowd, die hacker crowd, versprengte reste einer netzkunst crowd, einsprengsel einer soziologie crowd, jenseits von gut und böse sicher auch die crowd der künstler und journalisten), aber die köcheln alle relativ unbeobachtet und unbeeinflusst von den subdiskursen der anderen crowds vor sich hin, es sind ja wirklich nicht nur die journalisten, die sich nur an ihrer eigenen bubble orientieren.

(ich sehe keinen grund für hoffnung, dass da in absehbarer zeit was tolles kommt, aber das ist auch nicht wirklich wichtig. wichtiger ist eher, dass endlich die 10 oder so blödesten grundannahmen widerlegt werden und quasi nicht mehr salonfähig sind, das würde das grundpotential vom web in deutschland sofort verdoppeln. und eine mischung aus praxis und proaktiver falsifikation bei genügend freundlichkeit könnte ein solches plateau erzeugen oder zumindes zu einer art anpassung der blickwinkel führen)

3. gut gemeint ist schlecht gemacht.

auch das zieht sich wie ein faden durch die meisten problemfelder. künstler, intellektuelle, netzpolitische aufrufer, krautreporter, indiewebler und politiker eint, dass sie es immer wirklich gut meinen, aber mit ihren ansätzen und forderungen oft leider genau das gegenteil bewirken und sich so also zu erfüllungsgehilfen der hegemonialen strukturen machen.

besonders in kombination mit (1) einem nichtverstehen der dynamik der sozialen objekte und/oder (2) einem nichtverstehen der logik des werts und/oder (3) einem nichtverstehen der produktions-, rezeptions-, und distributionsbedingungen und der ströme wird ein gut gemeint schnell zu einem schlecht gemacht. der weg zur hölle ist gepflastert mit guten intentionen.

4 follow the money

wenn ein in ein paar tagen entwickeltes flappy bird mehr umsatz generiert als 99% aller webapps, dann wandern die talente früher oder später ins appland, auch wenn dort kein ‘gesellschaftlicher’ wert entsteht. mir fehlt zwar die intuition, zu welchem grad das wirklich ein problem ist (dem web fehlt es nämlich nicht an code sondern an verdichtungen, und die beginnen historisch oft mit zwei, drei leuten; wo es sich anbietet werden die mobil erzeugten inhalte dann ohnehin auch im web veröffentlicht; ob sich private ströme auf mobilen kanälen oder auf facebook realsieren ist – ausser für irgendwelche kennzahlen – völlig egal; usw.) aber ich vermute doch, dass es eine gewisse verschiebung der indifferenzkurven gibt, die das web mittelfristig suboptimal ausdifferenziert. oder anders gesagt: ich vermute, dass das web den monetären offset zum mobilen internet quasi durch sinn ausgleichen muss. die gefahr ansonsten ist nicht so sehr, dass es ‘weniger’ web gibt, sondern dass sich einige möglichkeitsräume, die sich nur im web entfalten könnten, einfach nicht entfalten können.

zauberhut

das allerwichtigste für eine schubumkehr dürfte jedenfalls eine art rudimentäre netzbildung mit netzpraxis oder wenn man so will eine allgemeine netzaufklärung sein. fast jedes problem eskaliert erst dadurch, dass die beteiligten und oft entscheidenden personen einige eigentlich ‘zumutbar wissbare’ dinge übersehen oder noch nicht verstanden haben und in der folge zu ‘falschen’ bewertungen und massnahmen kommen. und ich meine das wirklich nicht hochnäsig oder besserwisserisch oder im glauben eine ultimativ richtige antwort zu haben, aber es gibt halt situationen, wo man sehen kann, dass ein anderer etwas nicht sieht, was dieser naturgegeben nicht selbst sehen kann, weil man eben nur sieht was man sieht, aber nicht sieht was man nicht sieht. internet ist eben nicht segen oder fluch, internet ist ein möglichkeitsraum, der genützt werden kann oder nicht.

netzbildung bedeutet übrigens nicht, dass alle programmieren lernen sollten (diese idee kommt, kommt mir vor, immer von leuten, die selbst nicht programmieren können). bei der netzbildung gibt es sicherlich verschiedendliche ‘tiers’, wobei man aber schon mit wenig aufwand die meisten probleme in luft auflösen könnte (think pareto).

und ich habe kein programm dafür im zauberhut, aber mit sehr wenig wissen um einige techniken und zusammenhänge kann man schon sehr viel abfedern. wenn man etwa weiß, was ein browser ist und was man mit dem browser alles machen kann und wie man ihn erweitern und für sich selbst optimieren kann und dass browser auch einen privacy-modus haben und dass man auch mehrere browser gleichzeitig benutzen kann, dann hat man z.b. geschätzte 80% der nicht-staatlichen privacy-probleme schon im eigenen griff. (nur wird man das z.b. niemals im feuilleton lesen, weil das die leser ja dazu befähigen würde, die tracker zu blockieren, über die sie ihre leser monetarisieren. wir sind also auf uns selbst gestellt.)

Die Einmischer

Kl. Nachtrag zur Rede zur Lage der Nation :

Einmischen, machen oder zumindest spenden sind ja gerne genannte Anweisungen. Leider sind auch sie ein Beispiel für ‘gut gemeint ist schlecht gemacht’ weil sie as is leere Imperative sind, die es einer Gruppe erlaubt, kurz über sich selbst gerührt zu sein, dann aber konsequenzlos und ohne Anschluss bleiben, weil die Bissen und Probleme zu gross sind.

Ich würde deshalb vorschlagen, die ‘Verpflichtung’ zum Einmischen nach den Faktoren Nähe und Möglichkeit zu parametrisieren bzw. sie als ‘Funktion’ davon zu verstehen.

Man hat mehr ‘Verpflichtung’ sich um die Dinge zu kümmern, die einem nahe sind, und der Grad dieser Verpflichtung nimmt mit zunehmender Entfernung zunehmend ab. (Nähe kann sich dabei natürlich durchaus auch durch Interesse konstituieren usw.)

Und man hat mehr ‘Verpflichtung’ sich um die Dinge zu kümmern, die man selbst auch effektiv lösen kann oder zu denen man effizient beitragen kann, etwa weil man in der gesellschaftlichen Position dazu ist, und auch der Grad dieser Verpflichtung nimmt mit abnehmender Möglichkeit zunehmend ab.

Pick your battles.

Es bringt ja nichts, wenn man sich ein Jahr um irgendwas strauchelt, was aber keinen Effekt hat, oder was für einen anderen einen Anruf bedeutet hätte, oder was ein anderer dann mit einem Anruf blockieren kann, oder von dem man überhaupt nicht wissen kann, welche Effekte es überhaupt hat. Was aber auch nicht bedeutet, dass man vor größeren Themen resignieren soll, wenn man keinen direkten Einfluss hat; oft kann man etwa an Zwischenschritten arbeiten, Dinge synthetisieren und aktivieren usw.

Gleichzeitig entsteht Wertschätzung nur durch Einsatz, es zahlt sich also schon aus, im Rahmen der eigenen Mitteln und Möglichkeiten an Dingen und Verbesserungen zu arbeiten. Nette Geschichte Opa, komm, setz dich.

Tough Graders

Nur ein kleines Update, weil es hier ja etwas still war: der Grund dafür ist, dass meine data-bezogenen Energien mehr oder weniger vollständig von einigen MOOCs absorbiert wurden (siehe Data Moocs Spring/Summer 2014 und Data Moocs Spring 2014), und die waren (resp. sind) zwar teilweise tatsächlich sehr super, vermitteln aber grösstenteils halt einfach zu lernenden resp. zu verstehenden ‘kanonischen Stoff’, der aber selbst nicht wirklich Anschlusskommunikation sucht.

(nachdem ich eig. alle erwähnten moocs und noch einige andere zumindest angeschnuppert habe, sind unterm strich drei übrig geblieben, die ich dann mit gewisser hingabe gemacht habe (resp. noch mache): (1) data analysis and statistical inference von duke/coursera – eine wirklich grossartige einführung in die statistischen grundkonzepte, aber auch die damit verbundene ‘welt-’ und wissenschaftlichkeit und mit toolbox (r, rstudio, rmarkdown, knitr, pandoc) für reproducible research; neben der norvig klasse, siehe u.a. pierce hawthorne, bisher der mooc, wo ich mich am meisten anstrengen musste, um ihn überhaupt zu ‘schaffen’, was dann aber natürlich die wertigkeit für einen selbst mitunter auch erst konstituiert; und neben norvig und model studies sicher eines der highlights meiner bisherigen moocs overall; den impliziten humor von mine çetinkaya-rundel werde ich jedenfalls nicht vergessen. (2) exploratory data analysis von udacity – eine durchaus gute einführung in den datenanalytischen prozess, der vor allem eine ungeplante komplementierende visualisierungskomponente für die prinzipien von (1) mit r/ggplot2 beinhaltet, die dort vl. etwas zu kurz kam; ist aber auch an und für sich zumindest halbwegs durchdacht und überlegt (von den anderen kursen der neuen datenspezialisierung von udacity kann man das ja nicht wirlich sagen, die wirken mitunter eher lieblos rund um ein zu belegendes schlagwort zusammengewürfelt und sind eher keine werbung für ihr neues modell); und (3) the analytics edge vom mit/edx. das ist ein wilder ritt, der sich nicht lange mit den basics aufhält, sondern in woche 2 lineare regression, in woche 3 logistische regression, in woche 4 modellierungstechniken auf basis von entscheidungsbäumen und -wäldern, in woche 5 verschiedene strategien für natural language processing, in woche 6 hierarchisches und k-clustering und in der aktuellen woche 7 gerade einen – übrigens wirklich lustigen und durchaus kompetitiven – privaten wettbewerb auf kaggle offeriert. lineare und integer optimierung kommen noch. und während dabei dann natürlich viel ‘voodoo coding’ ist, ist das trotzdem auch eine nette alternative und abrundung zu (1) und (2); und während die ansätze unterschiedlicher nicht sein könnten, irgendwie haben sie sich interessanterweise recht harmonisch ergänzt und teilweise sogar wechselseitig beleuchtet)

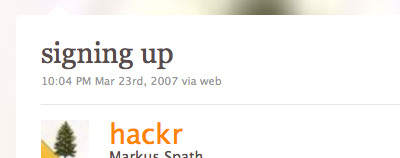

signing up 7

heute vor sieben jahren: 11746761

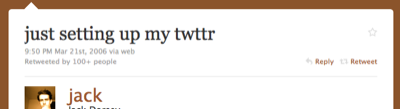

just setting up my twttr 8

Huch, vor acht Jahren wurde der erste Tweet abgesetzt.

(siehe t7, just setting up my twttr 6, just setting up my twttr 5, just setting up my twttr 4, just setting up my twttr, 2 jahre twitter und immr)

Data Moocs Spring/Summer 2014

Kl. Nachtrag zu Data Moocs Spring 2014: Praktischerweise starten im März und April eine ganze weitere Reihe an Kursen rund um Statistik und Data Analysis:

^ Data Analysis and Statistical Inference von Coursera (siehe) – läuft schon seit 2 Wochen, dauert 10 Wochen und ist sehr gut. Es kombiniert die Basics von Statistik und Wahrscheinlichkeitstheorie (bis zu multiple linear regression und bayesian inference) mit einem guten Schwung Praxis und einem grösseren Projekt.

^ Making Sense of Data von Google (siehe) – startet am 18. März und dürfte ein Crash-Kurs in Google Fusion Tables sein. Die bisherigen nativen Kurse von Google – Power Searching resp. Mapping With Google – waren beide überraschend gut.

Und ab 7. April startet Coursera gleich einen Schwung an 4-wöchigen Kursen im Rahmen einer ‘Spezialisierung’:

^ The Data Scientist’s Toolbox (siehe) – In this course you will get an introduction to the main tools and ideas in the data scientist’s toolbox. The course gives an overview of the data, questions, and tools that data analysts and data scientists work with. There are two components to this course. The first is a conceptual introduction to the ideas behind turning data into actionable knowledge. The second is a practical introduction to the tools that will be used in the program like version control, markdown, git, Github, R, and Rstudio.

^ R Programming (siehe) – In this course you will learn how to program in R and how to use R for effective data analysis.

^ Getting and Cleaning Data (siehe) – The course will cover the basics needed for collecting, cleaning, and sharing data.

Data Moocs Spring 2014

Praktischerweise starten im Februar und März gleich eine ganze Reihe an Kursen rund um Statistik und Data Analysis:

^ Intro to Data Science von Udacity (siehe) – hat diese Woche begonnen, dauert 5 Wochen und schaut nicht schlecht aus. Topics sind Data Manipulation, Data Analysis with Statistics and Machine Learning, Data Communication with Information Visualization und Data at Scale

, scheint Pandas zu verwenden.

^ Introduction to Probability von edX / MIT (siehe) – hat auch diese Woche begonnen, dauert 15 Wochen und schaut auch nicht schlecht aus und werd ich auf alle Fälle probieren, könnte mir aber zu mathematisch sein (multiple discrete or continuous random variables, expectations, and conditional distributions, laws of large numbers, the main tools of Bayesian inference methods, an introduction to random processes, Poisson processes and Markov chains

).

^ Introduction to Statistics von edX / UC Berkeley startet am 24. Feb und dauert 5 Wochen. Möchte ich auf alle Fälle machen. Ein bisschen Statistik braucht man einfach, weil sonst schnell Dinge zu unnötigen Roadblocks werden.

^ Data Wrangling with MongoDB von Udacity (siehe) – startet am 26. Feb, dauert 6 Wochen und schaut auch nicht schlecht aus. Students will learn how to collect, clean, and extract needed data and store it in MongoDB. We will also cover schema design, learn how to process data within MongoDB, and utilize Hadoop along with MongoDB to perform MapReduce operations.

.

^ The Analytics Edge von edX / MIT (siehe) – beginnt am 4. März, dauert 11 Wochen und schaut sehr interessant aus (Through these examples and many more, we will teach you the following analytics methods: linear regression, logistic regression, trees, text analytics, clustering, visualization, and optimization. We will being using the statistical software R to build models and work with data.

).

^ Exploratory Data Analysis wieder von Udacity (siehe) – startet am 12. März, dauert 6 Wochen und schaut auch nicht schlecht aus, scheint vor allem R zu verwenden.

Sabbatical

fyi: live.hackr nimmt ein kleines Sabbatical.

(marcel weiss hat mir hier den letzten schubs gegeben, die von ihm angesprochenen punkte – verlorener spass, zunehmende irritiertheit als ursache und die lazy-xxx serie als symptom usw. – keimen aber natürlich schon länger.

wovon ich etwas abstand gewinnen will ist übrigens nicht das web, das finde ich so erfrischend und erfreulich wie eh und je, sondern den diskurs darüber und die themen der sogenannten ‘netzgemeinde’.

für hackr bedeutet das, dass die chronistenpflicht bzw. die gedankenlos zu befüllenden ströme shared , news und chronicle weiterlaufen wie bisher, und auch bei live.hackr werde ich kleine fundstücke und katzencontent posten, also insgesamt nicht viel, aber ich werde versuchen, meinen inputstrom möglichst diskursfrei zu halten, was üblicherweise ja trigger für die papierkörbe, lazy blogs, leftovers, zeitgenossen, quizzes, etc. war und das will ich euch nicht mehr zumuten.

dafür gibt es mit data.hackr eine neue blog season zum thema small data, ein bisschen dazu hier. ein gedanke dabei ist, dass es vl. psychohygienisch ganz wohltuend ist, bei einem thema mal ganz unten anzufangen, weil quasi jeder andere weiter ist als man selbst und jede aussage eine information, und ich glaube zahlen sind für mich eine gute abwechslung)

37basecamps

^ holy moly, das ende einer ära:

This year marks 37signals’ 15th year in business. And today is Basecamp’s 10th birthday.

…

Here’s the first: Moving forward, we will be a one product company. That product will be Basecamp. Our entire company will rally around Basecamp.

…

So here’s the second big announcement: We’re changing our name. 37signals is now Basecamp.

We just cared more

^ devoha: Facebook wurde heute 10.